Защита кода: как GitGuardian предотвращает утечки секретов через ИИ-инструменты

Искусственный интеллект для написания кода стремительно входит в повседневную практику разработчиков. Инструменты вроде Cursor, Claude Code и GitHub Copilot теперь способны на большее, чем просто предлагать код. Они могут читать файлы, выполнять команды оболочки и обращаться к внешним сервисам прямо во время сессии. Это делает их полезными, но и создаёт новый риск: секретные данные могут быть раскрыты задолго до того, как код попадёт в репозиторий или конвейер непрерывной интеграции.

Разработчик может вставить API-ключ в запрос при отладке. ИИ-агент может прочитать файл .env, выполнить команду, выводящую учётные данные, или передать конфиденциальную информацию через MCP-вызов. Как только эти данные попадают в рабочий процесс с ИИ, они могут быть отправлены провайдеру модели, залогированы, закэшированы или иным образом скомпрометированы.

GitGuardian решает эту проблему, расширяя функционал ggshield за счёт сканирования секретов на основе хуков для инструментов ИИ-разработки. Цель проста: обнаруживать секреты в запросах и действиях агента достаточно рано, чтобы заблокировать их до отправки модели или выполнения.

Что это такое?

Поддержка ИИ-хуков от GitGuardian интегрируется со встроенными системами хуков Cursor, Claude Code и VS Code с GitHub Copilot. После установки ggshield сканирует контент в реальном времени во время разработки с помощью ИИ.

Продукт фокусируется на трёх ключевых моментах рабочего процесса:

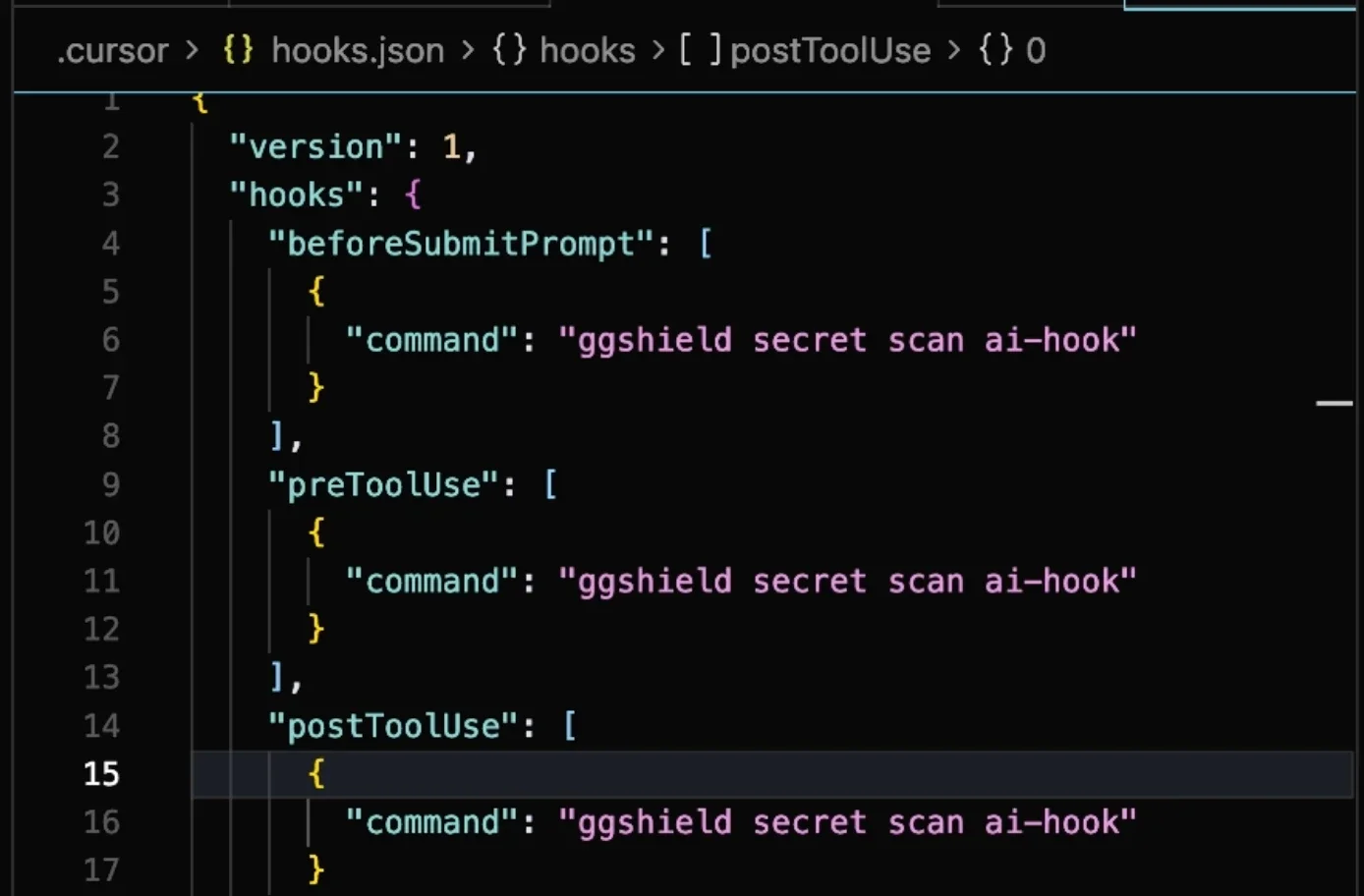

- Перед отправкой запроса: сканирует ввод разработчика до его передачи модели.

- Перед использованием инструмента: проверяет команды, чтение файлов и MCP-вызовы до их выполнения ассистентом.

- После использования инструмента: анализирует вывод инструмента. На этом этапе действие уже произошло, поэтому блокировки нет, но система может уведомить пользователя об обнаруженных секретах.

Это даёт организациям превентивный контроль в области, где у многих программ безопасности в настоящее время практически нет видимости.

Почему это важно

Большинство компаний уже имеют инструменты для сканирования репозиториев, коммитов или конвейеров CI на предмет утечки учётных данных. Но рабочие процессы с ИИ находятся вне этих средств контроля. Запросы, доступ к локальным файлам, вывод командной строки и инструменты, подключённые к моделям, часто невидимы для команд безопасности, хотя могут обрабатывать высокочувствительные данные.

Эту слепую зону становится всё сложнее игнорировать. Исследование GitGuardian «Состояние утечек секретов 2026» показало, что в 2025 году на публичный GitHub было добавлено 28,65 миллиона новых хардкодных секретов, в то время как утечки через сервисы ИИ выросли на 81%, демонстрируя, как быстро расширяется компрометация чувствительных данных по мере распространения ИИ-разработки.

Этот пробел важен по двум причинам.

Во-первых, секреты могут быть раскрыты ещё до того, как станут частью исходного кода.

Во-вторых, организации начинают задумываться об управлении ИИ в более широком смысле, особенно о том, к каким данным могут обращаться ИИ-агенты и что им разрешено отправлять в сторонние системы.

В этом контексте сканирование секретов на уровне хуков полезно не только как функция безопасности для разработчиков, но и как часть более широкой модели управления для использования агентного ИИ.

Как это работает

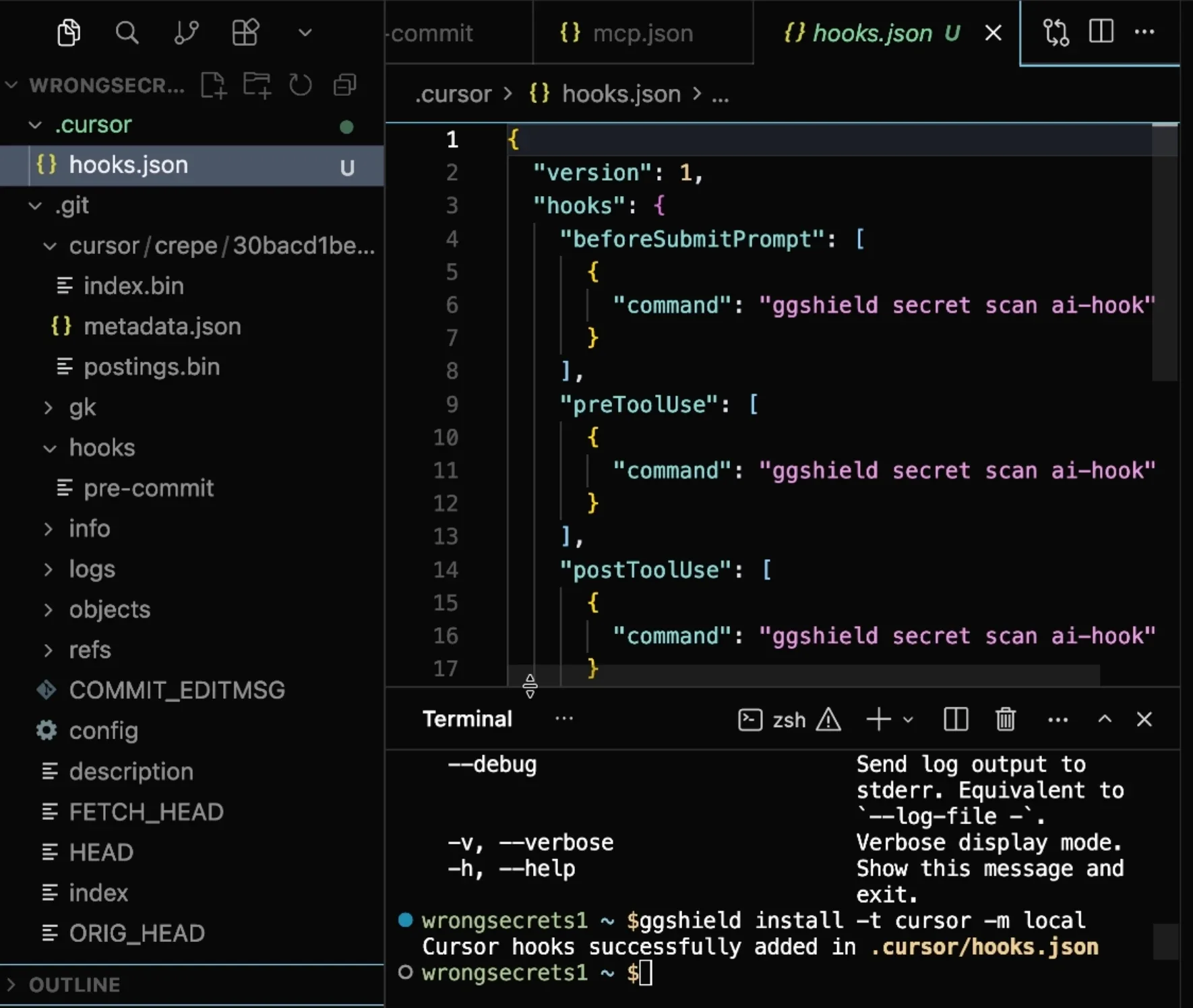

Настройка намеренно проста. Пользователи устанавливают интеграцию с помощью команды ggshield, глобально или для конкретного проекта. Затем ggshield записывает соответствующую конфигурацию хука для выбранного инструмента.

Например, Cursor можно настроить так:

ggshield install -t cursor -m global

Claude Code можно настроить так:

ggshield install -t claude-code -m global

VS Code с GitHub Copilot также поддерживается через ту же модель установки.

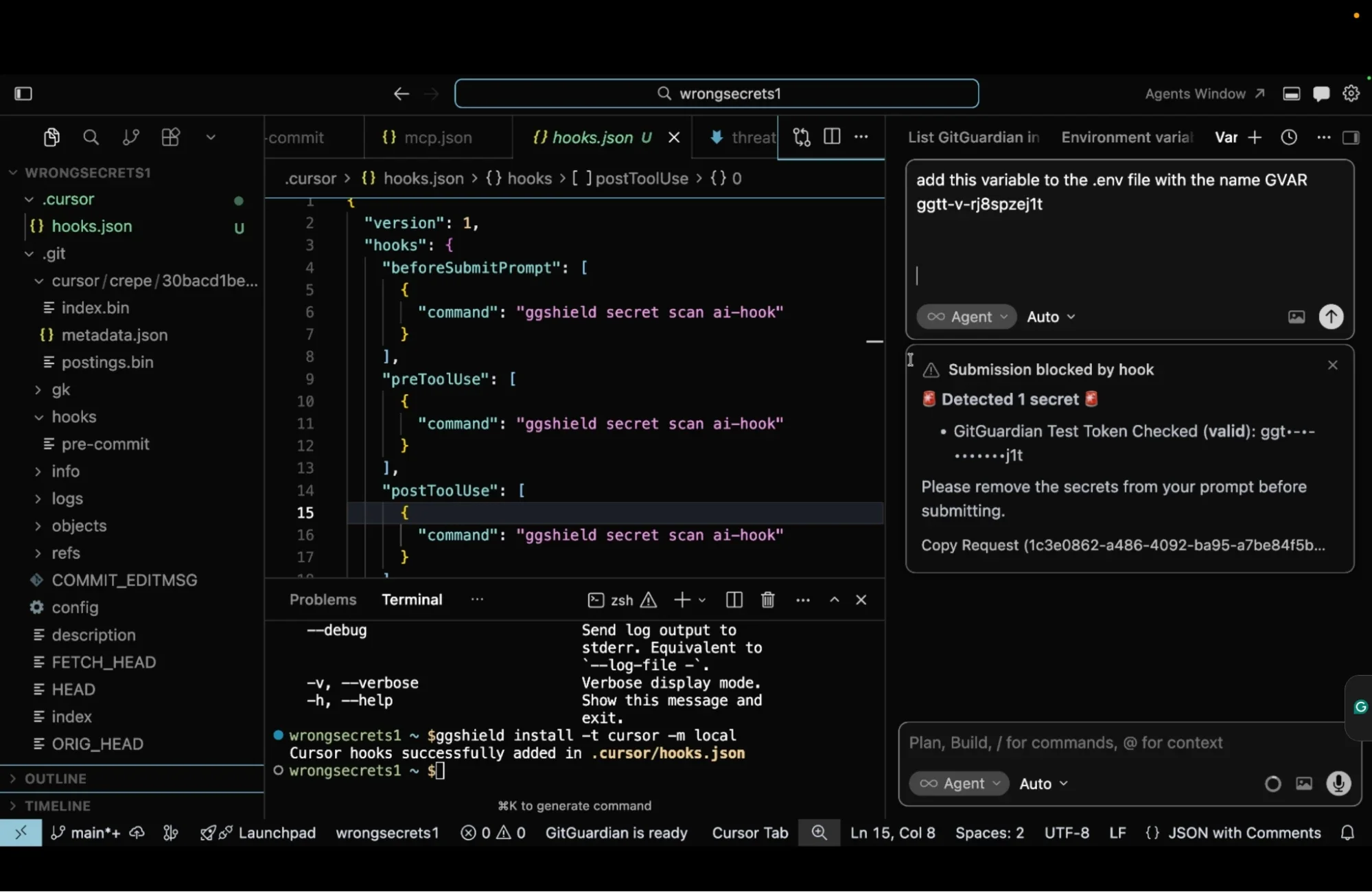

После включения хук запускается автоматически на настроенных этапах. Если секрет обнаружен в запросе или действии перед использованием инструмента, рабочий процесс блокируется, и разработчику предлагается удалить секрет перед повторной попыткой. Для обнаружений после использования инструмента GitGuardian отправляет настольное уведомление.

Интеграция не добавляет отдельную панель управления в рабочий процесс разработчика. Она полагается на стандартное поведение хуков каждого поддерживаемого инструмента, что делает опыт работы лёгким.

Что видят разработчики

При обнаружении секрета пользователь видит блокирующее сообщение в инструменте ИИ для программирования. В сообщении указывается проблема и предлагается удалить секрет перед продолжением.

Это важно, потому что предупреждение появляется в момент действия, а не позже при сканировании репозитория или в тикете. Разработчики получают обратную связь, когда возникает риск, что часто является моментом, когда его ещё проще всего исправить.

Если обнаружение является известным ложным срабатыванием, пользователи могут игнорировать последнюю находку с помощью существующего рабочего процесса GitGuardian:

ggshield secret ignore --last-found

Это правило игнорирования затем применяется к будущим проверкам, включая проверки хуков ИИ.

Покрытие обнаружения

Функция использует тот же механизм обнаружения GitGuardian, который применяется в других процессах сканирования секретов ggshield. Он охватывает более 500 типов секретов.

Такая согласованность полезна для команд, уже использующих GitGuardian в других местах. Это означает, что им не нужно внедрять отдельную модель обнаружения только для инструментов ИИ. Вместо этого они расширяют уже существующий подход к сканированию секретов на новую рабочую область, где учетные данные подвергаются всё большему риску.

Для кого это предназначено?

Эта возможность ориентирована на организации, которые уже используют ИИ-ассистентов для программирования и хотят установить некоторые защитные барьеры, не убирая эти инструменты из среды разработчиков.

Это особенно актуально для:

- Команд безопасности, обеспокоенных попаданием учетных данных в большие языковые модели или сторонние сервисы

- Команд платформы, внедряющих ИИ-ассистентов среди инженеров

- Регулируемых организаций, которым требуется большая видимость и контроль над рабочими процессами с ИИ

- Команд, изучающих MCP и управление агентами в рамках более широкой стратегии работы с нечеловеческими идентификаторами

Наиболее подходящими, вероятно, являются среды, где внедрение ИИ опережает разработку политик безопасности, и командам нужен практичный способ снизить риски, не замедляя разработку до полной остановки.

Заключительные мысли

ИИ-ассистенты для программирования добавляют новый слой в рабочий процесс разработки программного обеспечения, и у этого слоя есть свои проблемы безопасности. Утечка секретов через промпты, вызовы инструментов и действия агентов — одна из наиболее насущных, потому что она может происходить незаметно и вне контроля, которому организации уже доверяют.

Подход GitGuardian прост. Вместо того чтобы пытаться обнаружить проблему постфактум, он сканирует эти взаимодействия в реальном времени и, когда возможно, блокирует рискованные действия. Для команд, стремящихся внедрить элементы контроля безопасности в разработку с помощью ИИ, не создавая при этом излишних препятствий, эта возможность заслуживает пробного использования.