Выгорание в кибербезопасности: лишние часы работы каждую неделю

Специалисты по кибербезопасности в США в среднем работают на 10,8 дополнительных часов в неделю сверх установленного графика. Эти данные получены в результате опроса 300 руководителей в сфере кибербезопасности и ИТ, проведённого компанией Sapio Research. По сути, эта цифра добавляет к стандартной рабочей неделе целый шестой день для значительной части отрасли. Почти половина респондентов сообщили о работе 11 и более сверхурочных часов еженедельно, а каждый пятый — более 16 дополнительных часов.

Психологическое напряжение поддаётся измерению. Почти половина опрошенных заявили, что их работа чаще эмоционально истощает, чем приносит удовлетворение, причём это мнение наиболее выражено среди руководителей высшего звена. Значительная доля респондентов не может взять отпуск, не столкнувшись по возвращении с серьёзным накопленным стрессом, и примерно треть еженедельно испытывает тревогу в преддверии новой рабочей недели.

Несмотря на постоянное давление, 94% респондентов заявили, что снова выбрали бы карьеру в кибербезопасности, причём большинство сделало бы это без колебаний.

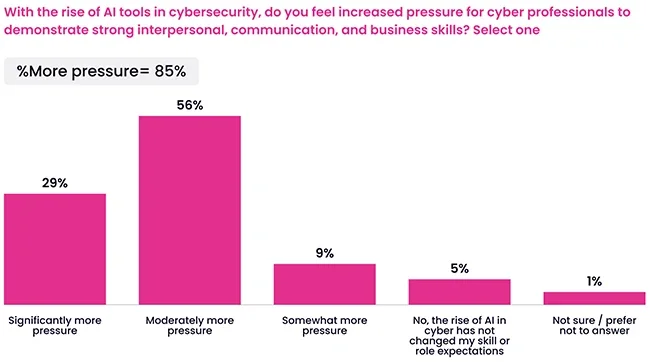

Давление ИИ на освоение нетехнических навыков (Источник: Seemplicity)

Профиль навыков меняется

Более восьми из десяти руководителей в сфере кибербезопасности заявили, что гибкие навыки, включая коммуникацию, умение влиять и управление заинтересованными сторонами, сейчас важнее для их эффективности, чем пять лет назад. Внедрение инструментов искусственного интеллекта ускоряет этот сдвиг: подавляющее большинство руководителей сообщают о возросшем давлении, требующем усиления межличностных, коммуникативных и деловых навыков как прямого следствия.

Воспринимаемая важность гибких навыков варьируется в зависимости от размера организации: руководители в небольших компаниях отмечают этот сдвиг чаще, чем их коллеги в крупных корпорациях. Большинство респондентов заявили, что их роль теперь требует значительного межфункционального взаимодействия и согласования с общей бизнес-стратегией.

Управление опережает инженерию

Когда руководителей спросили, какие компетенции будут определять специалиста по кибербезопасности в будущем, надзор и управление в сфере ИИ заняли первое место с результатом 73%. Технологическая и инженерная квалификация оказалась на втором месте, за ней следуют межфункциональная коммуникация, а также бизнес-стратегия и лидерство, каждый из которых отметила примерно половина респондентов.

Данные указывают на профессию, которая отходит от ручного технического исполнения. От специалистов всё чаще ожидают управления автоматизированными системами, аудита результатов работы ИИ и увязки решений в области безопасности с целями организации.

Многие компании добавляют обязанности по управлению ИИ к руководителям служб безопасности, не меняя базовую структуру должностей. «Наложение обязанностей по надзору за ИИ без перепроектирования организации команд лишь ускоряет профессиональное выгорание. Необходимо пересмотреть саму организационную схему», — заявил Равид Циркус, директор по продукту в Seemplicity, в интервью Help Net Security. «Саму организационную схему необходимо переработать».

Циркус отметил, что выделенные функции управления ИИ должны быть встроены в команды безопасности как операционные роли с чёткой подотчётностью. Это включает формальное владение результатами работы ИИ, пути эскалации, когда автоматизация даёт сбой, и рамки принятия решений, определяющие необходимость человеческого вмешательства. «Организациям нужно сделать шаг дальше простого внедрения инструментов ИИ и рассматривать его адаптацию как трансформацию лидерства», — сказал Циркус. «Кто отвечает за этот результат? Кому звонят в два часа ночи, когда автоматизированная система принимает неверное решение? Пока на эти вопросы нет ответов, закреплённых в организационной структуре, компании просто перераспределяют риски».

Бюджет есть, обучения — нет

Почти две трети респондентов заявили, что в их организациях достаточно бюджета для внедрения функций ИИ, причём в небольших компаниях уверенность была наиболее высокой. Более половины опрошенных, независимо от размера организации, охарактеризовали доступное обучение для взаимодействия человека и ИИ как ограниченное или недостаточное.

«Проблема не в бюджете, — сказал Циркус. — Организации покупают инструменты и пропускают следующий шаг: практическое, ролевое обучение». Речь идёт о подготовке, которая даёт ответы на повседневные вопросы руководителей безопасности: как проверить отчёт системы ИИ, когда её следует переопределить и как объяснить решение, принятое с помощью ИИ, совету директоров или регулятору.

Циркус также указал на отсутствие структурированных моделей для рабочих процессов с участием человека. Большинство команд импровизируют с распределением ответственности на ходу, не имея определённой модели для ситуаций, когда ИИ действует автономно, когда он рекомендует, а человек решает, и когда люди действуют полностью самостоятельно. «Эта граница размыта, и именно эта неопределённость вызывает ту усталость от принятия решений и операционные трения, которые мы видим в данных», — заключил Циркус.

Разрыв между капитальными вложениями и подготовкой персонала означает, что организации внедряют инструменты искусственного интеллекта, не обеспечивая специалистов необходимой подготовкой для управления ими. Руководители берут на себя бремя контроля вручную, вместо того чтобы создавать формальные системы обучения.

Доверие требует прозрачности и контроля

Руководители в сфере кибербезопасности называют постоянную, измеримую точность во времени главным фактором доверия к системам ИИ. Почти столь же высоко они ценят чёткую подотчётность, возможность человеческого вмешательства и прозрачные объяснения процесса принятия решений.

Данные показывают, что руководители демонстрируют заметно более высокое доверие к своим внутренним командам, чем к сторонним поставщикам. Эта разница связана с видимостью процессов и возможностью контроля. Восемьдесят семь процентов выразили преимущественно или полное доверие к внутренним командам в ответственном использовании ИИ, по сравнению с 77% в отношении поставщиков решений для кибербезопасности.

Эксперты отмечают, что поставщикам необходимо сократить этот разрыв, встраивая объяснимость непосредственно в свои продукты. Это включает журналы аудита, эффективные механизмы ручного переопределения и честную коммуникацию о возможных слабых местах модели. «Когда руководители по безопасности чувствуют ответственность за результаты работы «чёрного ящика», в который они не могут заглянуть, это подрывает доверие и усложняет управление», — пояснили аналитики. Установленный стандарт таков: каждое решение, принятое с помощью ИИ, должно сопровождаться понятным ответом на вопрос, кто несёт ответственность в случае ошибки и как эта ошибка может быть обнаружена до того, как она нанесёт ущерб. «Когда поставщики могут дать такой ответ, доверие появляется», — заключают эксперты.

Скачать: Отчёт Tines Voice of Security 2026