Кому принадлежит доступ к ИИ-агентам? В большинстве компаний ответа нет

Искусственные интеллекты уже активно работают в производственных корпоративных средах, однако инфраструктура управления их доступом не успевает за скоростью их внедрения.

Опрос, проведённый Альянсом облачной безопасности в январе 2026 года среди 228 ИТ-специалистов и специалистов по безопасности, показывает, что в большинстве организаций ИИ-агенты действуют в ключевых системах, при этом контроль над их аутентификацией и правами доступа раздроблен.

Агенты внедрены в производственные системы

Агенты для автоматизации задач используются в 67% опрошенных организаций. Агенты для извлечения данных и исследований развёрнуты в 52%, а агенты для генерации кода и для безопасности или мониторинга — в 50% организаций каждый. Агенты для инфраструктуры и ИТ-операций работают в 41% компаний. Лишь 15% респондентов заявили, что их организации не используют ИИ-агентов в рабочих средах.

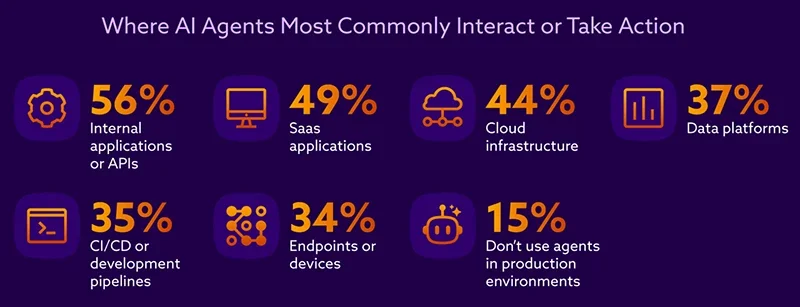

Чаще всего агенты взаимодействуют с внутренними приложениями или API (56%), далее следуют SaaS-приложения (49%) и облачная инфраструктура (44%). Более трети отмечают активность агентов в CI/CD-процессах или конвейерах разработки (35%) и на платформах данных (37%).

Семьдесят три процента респондентов ожидают, что в ближайшие 12 месяцев ИИ-агенты станут очень важными или критически важными для их организаций.

Назначение идентификаторов разрозненно

Когда ИИ-агент выполняет действие, в 52% организаций его представляют с помощью идентификатора приложения или рабочей нагрузки. Сорок три процента используют общий или универсальный сервисный аккаунт, 36% присваивают агенту его собственный уникальный идентификатор, а 31% разрешают агентам действовать под идентификатором человека. Двенадцать процентов не уверены, как представлена идентичность. Часто в одной организации сосуществуют несколько подходов одновременно.

Большинство организаций не могут чётко отличить действия, выполненные ИИ-агентами, от действий людей. Внутри одних и тех же компаний разные команды описывают ИИ-агентов непоследовательно.

Ответственность не закреплена за одной командой

Ответственность за определение способов аутентификации и доступа ИИ-агентов к системам распределена между командами безопасности, разработки, инженерии и ИТ, причём ни одна функция не обладает чёткими полномочиями. Команды, отвечающие за идентификацию и управление доступом (IAM), редко назначаются основными владельцами процесса, а в части организаций и вовсе нет определённого ответственного лица.

Когда ИИ-агент совершает непреднамеренное или нежелательное действие, 28% организаций возлагают ответственность на отделы безопасности или ИТ, 25% — на разработчиков или инженеров, а 18% — на бизнес- или продуктовых владельцев. Пятнадцать процентов не уверены, кто должен нести ответственность.

Системы контроля доступа демонстрируют заметные пробелы

Пятьдесят семь процентов респондентов сообщают о средней или высокой уверенности в том, что ИИ-агенты в их организациях имеют соответствующим образом ограниченный доступ к системам и данным. Однако лежащие в основе практики раскрывают более сложную картину.

Значительная доля респондентов не уверена, как часто обновляются или меняются учетные данные, используемые ИИ-агентами, а меньшая часть сообщает, что такая ротация происходит редко или никогда. Фреймворки контроля доступа последовательно применяются к ИИ-агентам лишь в меньшинстве организаций, при этом заметная доля либо не имеет единообразия в подходах, либо не уверена в собственных практиках.

Настройка аутентификации и управления учетными данными для типичного ИИ-агента требует от одного до десяти дней инженерных усилий в 43% организаций. Тридцать два процента не знают, сколько времени это занимает.

Агенты наследуют разрешения, а не имеют собственные

В большинстве организаций доступ ИИ-агентов определяется предопределенной логикой автоматизации или правами человека, инициирующего действие. Лишь в меньшинстве компаний доступ основывается на собственных разрешениях агента.

Большинство респондентов заявляют, что ИИ-агенты хотя бы иногда наследуют доступ, изначально предназначенный для человека или другой системы. Многие согласны, что агенты часто получают больше прав, чем необходимо для выполнения их задач, и аналогично большая доля признает, что агенты создают каналы доступа, которые сложно отслеживать.

Восемьдесят один процент согласны, что манипуляция промптом может заставить ИИ-агента раскрыть конфиденциальные учетные данные или токены.

Среди открытых ответов наиболее часто упоминаемой проблемой (24%) является избыточный доступ или чрезмерные разрешения, за которыми следует отсутствие видимости поведения ИИ-агента (19%).

Управление заполняет пробелы, оставленные системами контроля доступа

В настоящее время организации полагаются на ограничения, основанные на политиках, а также на этапы человеческого одобрения или проверки для контроля высокорисковых или чувствительных действий ИИ-агентов. Только ведение логов и постфактумный мониторинг используют 39%, а проверки или валидации в реальном времени — 32%.

Для отзыва или ограничения доступа агента наиболее распространёнными механизмами являются отключение его идентификатора и аннулирование активных токенов сессии. Значительная доля организаций сообщает о завершении работы вычислительной среды, в которой работает агент. Меньшее число организаций способно удалять или изменять политики доступа в реальном времени, а небольшая часть сообщает об отсутствии каких-либо механизмов отзыва.

Специалисты указывают на прозрачность и разделение идентификаторов как на приоритеты

На вопрос о том, какие возможности наиболее улучшат способность их организаций безопасно масштабировать ИИ-агентов, 52% выбрали мониторинг действий агентов в реальном времени. 45% выбрали чёткое разделение идентификаторов между ИИ-агентами и людьми. Возможность предоставлять доступ для конкретной задачи на короткий срок выбрали 32%, а стандартизированные методы аутентификации — 30%.

Большинство респондентов ожидают, что предотвращение избыточных привилегий у агентов станет более серьёзной проблемой по мере расширения агентского ИИ. Многие также ожидают, что различение активности человека и агента усложнится, а управление секретами, учётными данными и шаблонами доступа в различных средах оценивается как растущая проблема.

Вебинар: Реальное состояние безопасности 2026