От помощника к автономному агенту: как безопасность не успела за ИИ

Внедрение корпоративного искусственного интеллекта перешло от пилотных проектов к промышленным системам, обрабатывающим клиентские данные, выполняющим бизнес-транзакции и интегрирующимся с ключевой инфраструктурой. Это выявило серьёзный разрыв между возможностями ИИ-агентов и тем, что могут отслеживать или контролировать команды безопасности.

Документ, опубликованный Консорциумом AIUC-1 и подготовленный с участием Лаборатории надёжного ИИ Стэнфорда и более 40 руководителей в сфере безопасности, фиксирует проблемы, возникшие в 2025 году, и прогнозирует риски, которые с наибольшей вероятностью затронут организации в 2026 году. Среди авторов — директора по информационной безопасности Confluent, Elastic, UiPath и Deutsche Börse, а также исследователи и консультанты из MIT Sloan, Scale AI и Databricks.

Согласно опросу EY, приведённому в документе, 64% компаний с годовым оборотом свыше 1 миллиарда долларов потеряли более 1 миллиона долларов из-за сбоев ИИ. Каждая пятая организация сообщила об утечке, связанной с несанкционированным использованием ИИ, часто называемым «теневым ИИ».

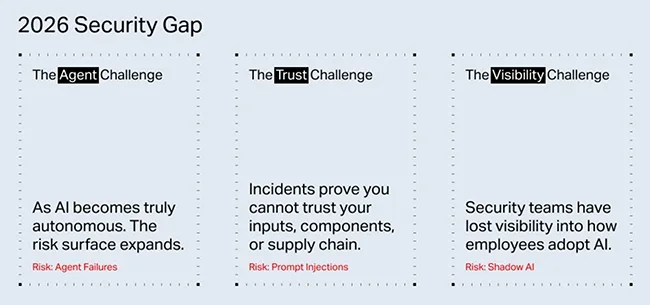

Три ключевые проблемы безопасности

В документе выделены три основные категории рисков, с которыми сейчас сталкиваются специалисты по безопасности.

Первая — это проблема агентов. Системы ИИ эволюционировали от помощников, отвечающих на запросы, до автономных агентов, выполняющих многошаговые задачи, использующих внешние инструменты и принимающих решения без одобрения человека для каждого действия. Это создаёт условия для сбоев, которые возникают даже без вмешательства злоумышленника. Агент с избыточными правами доступа и слабыми границами изоляции может нанести ущерб в ходе обычной работы. Восемьдесят процентов опрошенных организаций сообщили о рискованном поведении агентов, включая несанкционированный доступ к системам и неправомерное раскрытие данных. Лишь 21% руководителей заявили о полной прозрачности в отношении прав агентов, использования инструментов или шаблонов доступа к данным.

Омар Хаваджа, вице-президент и полевой директор по информационной безопасности в Databricks, отметил, что компоненты ИИ постоянно меняются по всей цепочке поставок, а существующие средства контроля безопасности рассчитаны на статичные активы, что создаёт слепые зоны при изменении поведения.

Вторая проблема — это отсутствие контроля. Шестьдесят три процента сотрудников, использовавших инструменты искусственного интеллекта в 2025 году, вставляли конфиденциальные корпоративные данные, включая исходный код и записи клиентов, в личные аккаунты чат-ботов. В среднем на предприятии используется примерно 1200 неавторизованных ИИ-приложений, при этом 86% организаций сообщают об отсутствии видимости потоков данных в их ИИ-системах. Утечки данных через "теневой ИИ" обходятся в среднем на 670 000 долларов дороже стандартных инцидентов безопасности из-за позднего обнаружения и сложности определения масштабов компрометации.

Третья проблема — это проблема доверия. В 2025 году инъекции промптов перешли из академических исследований в разряд повторяющихся инцидентов в реальных системах. В списке OWASP Top 10 для больших языковых моделей 2025 года инъекция промптов заняла первое место. Эта уязвимость существует потому, что большие языковые модели не могут надежно отделять инструкции от входных данных. Пятьдесят три процента компаний сейчас используют генерацию с извлечением информации или агентские конвейеры, каждый из которых создает новые поверхности для атак.

Существующие стандарты недостаточны для специфических рисков агентов

Такие стандарты, как NIST AI RMF и ISO 42001, предлагают организационные структуры управления, включая комитеты по рискам и требования к документации. Они не затрагивают конкретные технические меры контроля, необходимые руководителям по информационной безопасности для развертывания агентских систем, такие как проверка параметров вызова инструментов, логирование инъекций промптов или тестирование изоляции для мультиагентных систем.

Санми Койежо, возглавляющий Лабораторию исследований надежного ИИ в Стэнфорде, признал, что крупномасштабные лонгитюдные исследования, сравнивающие частоту инцидентов между организациями, использующими технически специфичные стандарты, и теми, кто полагается на общее управление, пока не существуют. «AIUC-1 все еще находится на ранней стадии внедрения, а область безопасности ИИ-агентов слишком молода для такого контролируемого сравнения», — сообщил он Help Net Security. Исследования его лаборатории показали, что защитные механизмы на уровне модели сами по себе недостаточны: атаки с тонкой настройкой обходили Claude Haiku в 72% случаев, а GPT-4o — в 57%. Специфичные технические средства контроля добавляют проверку входных данных, защитные механизмы на уровне действий и видимость цепочки рассуждений, чего не хватает безопасности на уровне модели. Койежо провел аналогию с внедрением многофакторной аутентификации в традиционной кибербезопасности, отметив, что конкретные, поддающиеся аудиту технические меры снижали риск взлома так, как не могли это сделать обязательства высокого уровня.

Пионеры внедрения технически обоснованных стандартов безопасности ИИ сообщают о более быстрых циклах закупок, лучшей готовности к аудиту и снижении сложностей при развертывании агентов в регулируемых средах, по словам Койехо. Кейс-стади по применению структурированных мер контроля безопасности ИИ в компании AllianceBernstein, работающей в сфере финансовых услуг, было опубликовано Virtue AI, соучредителем которой является Койеджо.

Обеспечение ресурсами для непрерывного тестирования на устойчивость

В брифинге рекомендуется, чтобы организации интегрировали непрерывное «красное командирование» в операционную деятельность агентов на постоянной основе. Нэнси Ван, технический директор 1Password, заявила, что операционная модель для предприятий, не имеющих внутренней экспертизы в области безопасности ИИ, должна сочетать стандартные настройки платформы, автоматизацию и целевые знания, а не полагаться на большие специализированные команды.

«Базовые защитные механизмы должны быть встроены в сами платформы», — сказала Ван. «Изолированное выполнение инструментов, ограниченные и краткосрочные учетные данные, применение политик во время выполнения и всестороннее аудит-логирование не должны требовать индивидуальной инженерной разработки». Тестирование на устойчивость, по ее словам, должно быть интегрировано в рабочие процессы CI и выпуска, чтобы обновления моделей, изменения промптов или перенастройки агентов автоматически запускали предопределенные наборы атак. Затем эксперты-люди исследуют значимые отклонения, а не вручную повторяют полные сценарии.

Ван рекомендовала классифицировать агентов по уровню риска. Агенты с доступом к конфиденциальным данным или производственным системам требуют непрерывного тестирования на устойчивость и более строгих контрольных точек. Агенты с низким уровнем риска могут полагаться на стандартизированные меры контроля и периодическую выборочную проверку. «Цель — сделать непрерывную валидацию частью жизненного цикла разработки», — сказала она.

Лаборатория Койеджо напрямую занимается вопросом автоматизации. Исследование того, что лаборатория называет AutoRedTeamer, показало, что автоматизированный выбор атак может снизить вычислительные затраты на 42–58% по сравнению с простыми подходами, обеспечивая при этом более широкий охват уязвимостей. Он рекомендовал организациям с ограниченными ресурсами начать с автоматизированного непрерывного тестирования, привязанного к конвейерам развертывания, внедрить защитные механизмы времени выполнения до того, как любой агент с доступом к конфиденциальным данным или реальным инструментам будет запущен в производство, и использовать «красное командирование» с участием людей выборочно для развертываний с высокими ставками.

В сфере защиты идентификационных данных и облачных систем Ван отметила, что переход от декларативных политик высокого уровня к принудительно применяемым мерам контроля, таким как минимальные привилегии, краткосрочные учетные данные и токены с ограниченной областью действия, существенно сократил возможности горизонтального перемещения и ограничил последствия при возникновении инцидентов. «Агенты с жестко ограниченными возможностями и временными учетными данными просто не могут получить доступ к тому, что им никогда не предоставлялось, — сказала она. — Это конкретное и наблюдаемое отличие».