NVIDIA доверяет сообществу управление GPU-оркестрацией

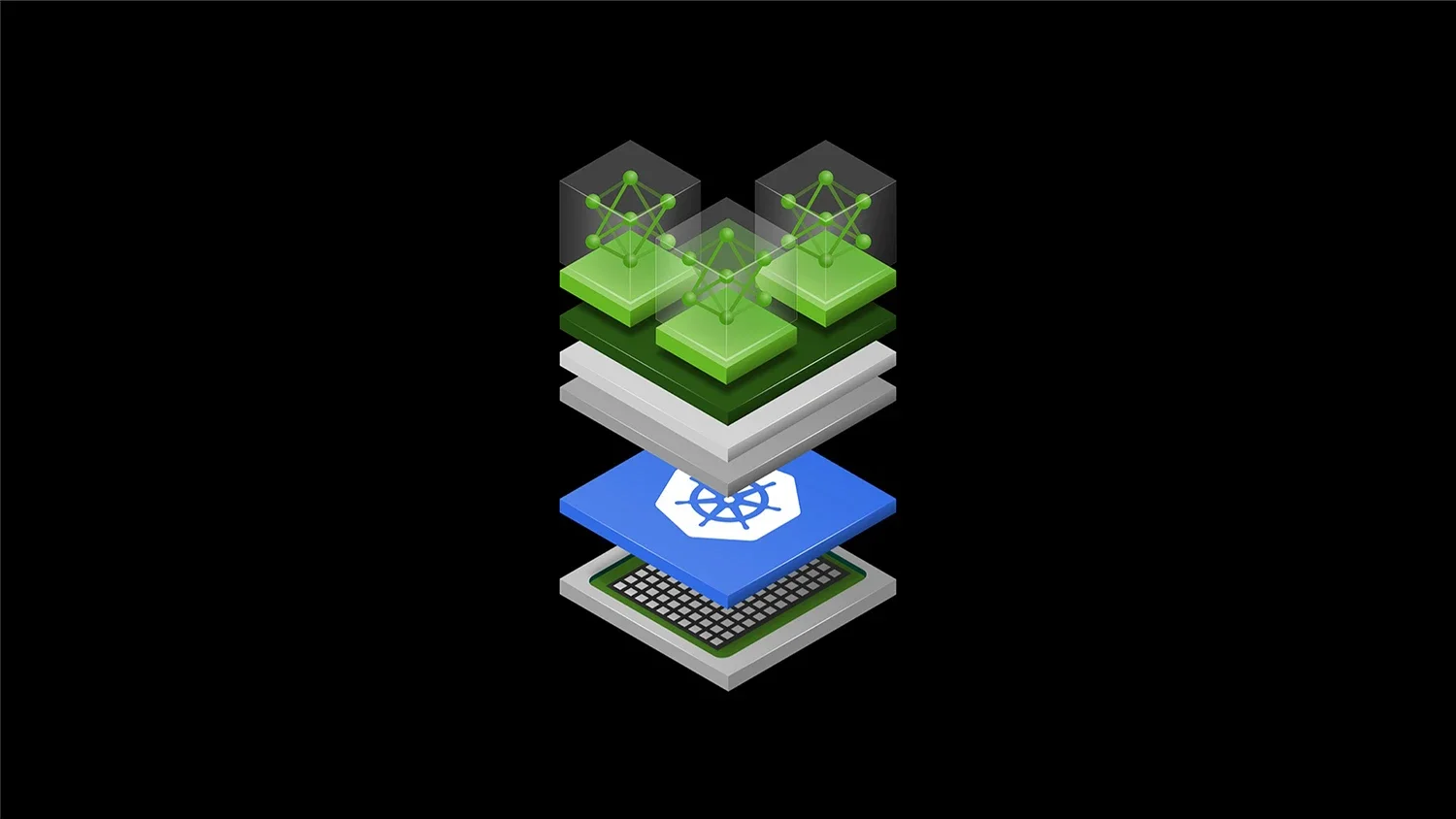

Ускоренные графическими процессорами задачи искусственного интеллекта теперь выполняются на Kubernetes в подавляющем большинстве корпоративных сред. Управление такими рабочими нагрузками в масштабе требовало специализированных инструментов, которые до сих пор оставались под контролем вендоров. NVIDIA решила изменить эту ситуацию на прошедшей на этой неделе в Амстердаме конференции KubeCon Europe, передав свой драйвер динамического распределения ресурсов для графических процессоров в фонд Cloud Native Computing Foundation.

Эта передача переводит управление драйвером от NVIDIA к более широкому сообществу проекта Kubernetes. Теперь разработчики из разных компаний смогут напрямую вносить вклад в код, предлагать изменения и влиять на развитие планирования ресурсов графических процессоров в Kubernetes, не направляя запросы через единственного вендора.

Функциональность драйвера

Драйвер динамического распределения ресурсов для графических процессоров выступает посредником между Kubernetes и базовым аппаратным обеспечением, управляя распределением вычислительных ресурсов для контейнеризированных рабочих нагрузок. Переданная версия поддерживает несколько функций, важных для крупномасштабной инфраструктуры искусственного интеллекта: совместное использование графических процессоров через технологии NVIDIA Multi-Process Service и Multi-Instance GPU, нативную поддержку межсоединений NVLink между несколькими узлами, используемых в системах Grace Blackwell, динамическую перенастройку аппаратных ресурсов во время выполнения, а также детальные запросы на конкретные настройки памяти или конфигурации соединений.

Конфиденциальные контейнеры для задач искусственного интеллекта

Параллельно с передачей драйвера NVIDIA анонсировала поддержку графических процессоров для Kata Containers, разработанную совместно с сообществом Confidential Containers фонда CNCF. Kata Containers — это легковесные виртуальные машины, которые функционируют как контейнеры, обеспечивая более строгую изоляцию рабочих нагрузок по сравнению со стандартными средами выполнения контейнеров.

Добавление поддержки графических процессоров в Kata расширяет аппаратное ускорение в эту изолированную среду, что позволяет задачам искусственного интеллекта выполняться с дополнительной защитой конфиденциальности данных. Организации, стремящиеся внедрить конфиденциальные вычисления для чувствительных задач вывода или обучения, получают возможность сделать это в рамках существующей экосистемы Kubernetes.

Поддержка индустрии

Передача драйвера динамического распределения ресурсов осуществляется при участии нескольких крупных поставщиков облачных и инфраструктурных услуг. Amazon Web Services, Broadcom, Canonical, Google Cloud, Microsoft, Nutanix, Red Hat и SUSE сотрудничают с NVIDIA в рамках этой инициативы.

Крис Анищик, технический директор CNCF, прокомментировал важность этого шага: «Глубокое сотрудничество NVIDIA с сообществами Kubernetes и CNCF по интеграции драйвера NVIDIA DRA для GPU в основную ветку разработки представляет собой важную веху для открытой экосистемы Kubernetes и инфраструктуры ИИ. Согласовав свои аппаратные инновации с основными усилиями Kubernetes и инициативами по соответствию стандартам ИИ, NVIDIA делает высокопроизводительную оркестрацию GPU беспрепятственной и доступной для всех».

Крис Райт, технический директор Red Hat, связал это пожертвование с корпоративной стратегией в области ИИ, отметив, что открытый исходный код привносит стандартизацию в компоненты инфраструктуры, которые питают производственные рабочие нагрузки ИИ. Рикардо Роча, руководитель инфраструктуры платформ в ЦЕРНе, указал на ценность для научных вычислений, где инструменты, создаваемые сообществом, помогают организациям обрабатывать петабайты данных как в традиционных, так и в машинных рабочих нагрузках.

Дополнительные проекты с открытым исходным кодом

На KubeCon были отмечены и несколько других проектов, связанных с безопасностью инфраструктуры ИИ и управлением агентами. NVIDIA OpenShell, анонсированная на GTC на прошлой неделе, представляет собой среду выполнения для автономных агентов с детализированным программным контролем политик. Она нативно интегрируется с Linux, eBPF и Kubernetes и предназначена для того, чтобы позволить операторам определять границы безопасности и конфиденциальности для агентских рабочих нагрузок на детальном уровне. Система устранения неисправностей GPU NVSentinel и агентская платформа ИИ AI Cluster Runtime также были представлены на GTC.

В сфере оркестрации NVIDIA выпустила Grove — открытый API Kubernetes для управления рабочими нагрузками ИИ в кластерах GPU. Grove позволяет разработчикам описывать сложные системы логического вывода в едином декларативном ресурсе и интегрируется со стеком вывода llm-d для использования в сообществе Kubernetes. Grove расширяет экосистему Dynamo 1.0, выпущенную NVIDIA ранее.

Актуальность для безопасности

Сочетание поддержки конфиденциальных контейнеров, контроля политик OpenShell и изоляции рабочих нагрузок на уровне GPU устраняет пробел, за которым следили команды безопасности в средах Kubernetes с ускорением на GPU: отсутствие аппаратно-поддерживаемой изоляции для заданий логического вывода ИИ, обрабатывающих конфиденциальные данные.

Kata Containers с поддержкой GPU предоставляет операторам механизм для усиления границ между рабочими нагрузками на аппаратном уровне, используя стандартные примитивы Kubernetes. OpenShell добавляет слой программируемых контролей для агентных нагрузок, где поведение во время выполнения сложнее ограничить с помощью традиционных политик управления доступом. Вместе эти инструменты расширяют средства безопасности на области стека ИИ, которые ранее не были охвачены стандартными средствами защиты контейнеров.